OpenRouter:一站式AI模型的硬核接口

OpenRouter:一站式AI模型的硬核接口

壹拾贰OpenRouter:一站式AI模型的硬核接口

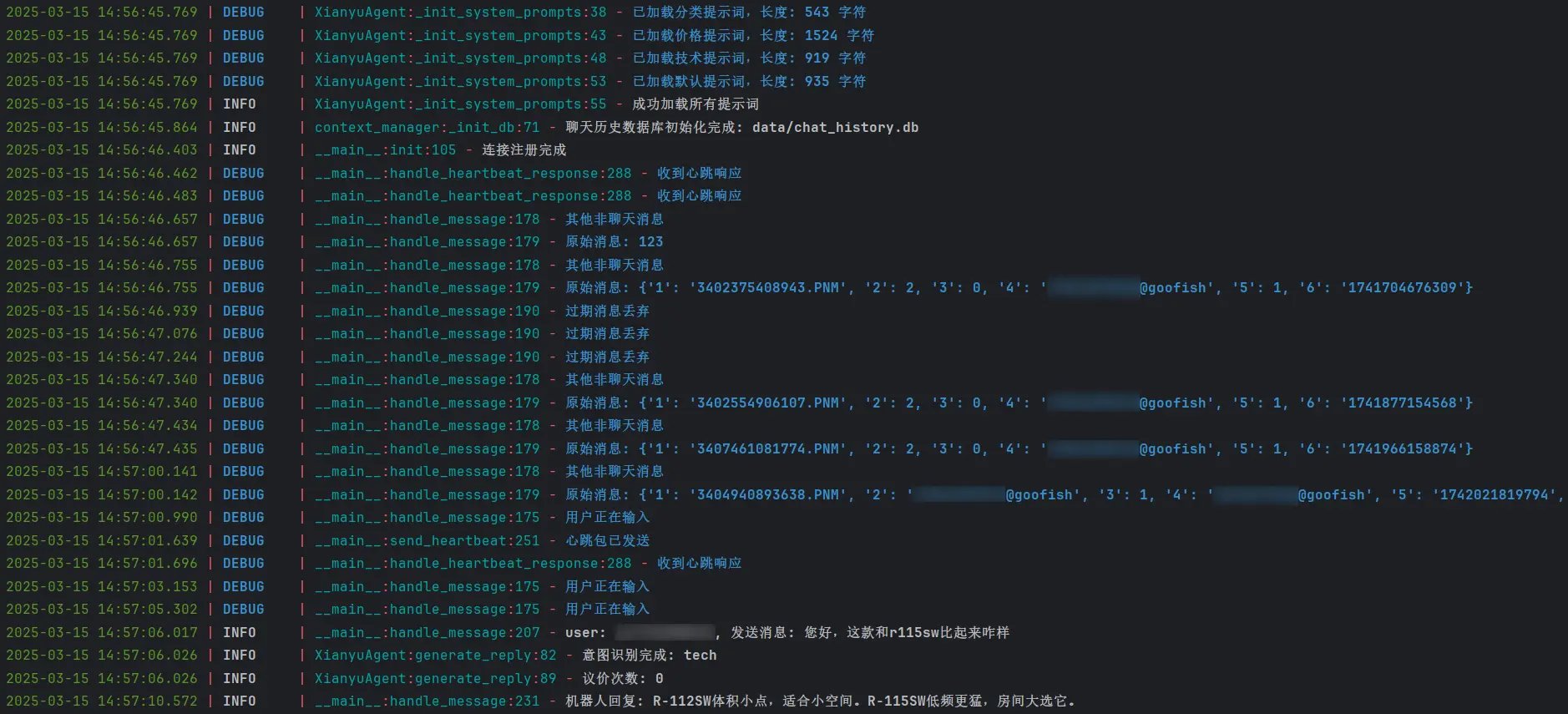

如果你是个开发者,或者只是想玩转AI模型但不想被各种API限制烦死,OpenRouter(https://openrouter.ai/)可能是你2025年的最佳发现。这玩意儿是个统一的API接口,能让你一次性接入几百个大型语言模型(LLM),从OpenAI的GPT-4o到Anthropic的Claude,再到Google的Gemini,甚至一堆开源模型像LLaMA和Mistral,全都塞在一个平台里。它的核心卖点?省钱、省事、随便搞。

啥是OpenRouter?

简单说,OpenRouter是个AI模型的“代理商”。你不用去跟每个模型提供商(OpenAI、Anthropic、Meta等等)单独签协议、弄API密钥、调代码。它给你一个标准化的入口,拿一个API密钥就能调用所有支持的模型。想换模型?改个参数就行,代码都不用动。2025年3月24日凌晨1点,我翻了它的官网,模型列表已经多到眼花缭乱,贵的便宜的都有,连免费的也有几个。

它还有个骚操作:自动降级和成本优化。如果某个模型挂了,它会自己切换到备用选项;如果你想省钱,它能根据价格和性能帮你挑最划算的。官网上写着“企业级高可用性”和“按需付费”,听起来很牛逼,实际上对个人开发者也够用。

怎么用?

注册个账号(Google登录或者MetaMask都行),去https://openrouter.ai/keys 弄个API密钥,然后直接开干。它的API跟OpenAI的格式几乎一样,如果你之前用过GPT-4的SDK,基本无缝切换。举个例子,想用Claude 3.5 Sonnet写个东西?代码长这样:

1 | import OpenAI from 'openai'; |

就这么简单。想试试最新的GPT-4.5 Preview或者Mistral的开源货,改下model参数就行。官网还有个聊天室,能同时跟多个模型对线,测试哪个更靠谱。

能干啥?

这东西的应用场景多得离谱。写代码?调个编程强的模型像Google的PaLM 2,直接扔需求过去。搞内容创作?Claude 3 Haiku速度快又便宜,批量生成文章没问题。想黑科技点?弄个开源模型跑在本地,再用OpenRouter的API做补充,混搭出自己的AI怪兽。它甚至支持流式输出(streaming)和函数调用,复杂任务也能搞定。

我随便翻了下,它还接了些冷门模型,比如AI21的Jamba或者Nous的Capybara,适合特定需求(比如多语言或者角色扮演)。价格透明,按token算,贵的像GPT-4o每百万输入token 2.5刀,便宜的免费模型随便用。

为啥牛逼?

省钱:不用给每个提供商单独掏订阅费,一个密钥全搞定,穷逼开发者的福音。

灵活:几百个模型随便挑,随时换,省得被单一模型锁死。

硬核:支持高级功能,像长上下文(128k token起步)、实时流输出,企业级需求也能扛。

社区驱动:开源项目OpenRouter Runner(GitHub上有),跑自己的模型还能赚流量分成。

有啥坑?

也不是没缺点。模型太多,挑起来头晕,新手可能不知道哪个适合自己。API密钥得充点钱,有些高级模型(像GPT-4.5)烧token很快,没设置限额的话钱包可能会炸。还有,虽然它号称高可用性,但具体延迟和稳定性得看你选的模型和当时网络情况。

总结

OpenRouter就是个AI界的“瑞士军刀”,不管你是想随便玩玩还是正经开发,都能找到用处。2025年这时候,AI模型多得跟超市货架似的,自己一家家试太累,OpenRouter直接把货全摆你面前,想怎么搞就怎么搞。

微信公众号小贴士:想解锁更多硬核内容?点击左下角【阅读原文】一探究竟!